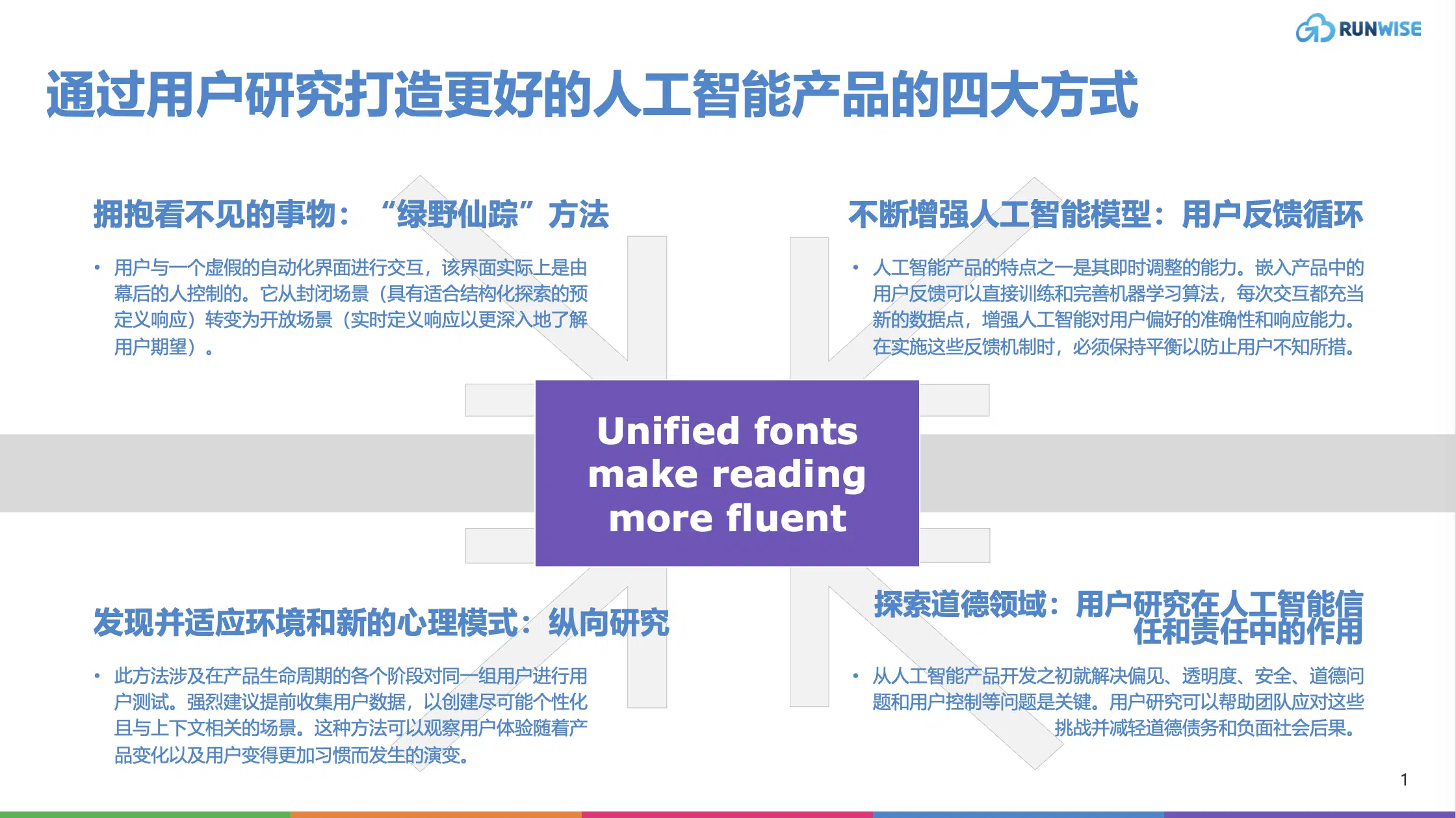

每个人都对人工智能感到兴奋,但对错过机会 (FOMO) 的恐惧正在驱使公司将人工智能嵌入到每个产品功能中。这可能会导致以技术为中心的方法,从而掩盖产品开发的基本目标:创建真正解决用户问题并满足他们需求的解决方案。本文将介绍通过用户研究打造更好的人工智能产品的四大方式。

模拟人类思维和决策的计算机程序的概念,即人工智能(AI),并不新鲜。它的历史可以追溯到 20 世纪 50 年代。多年来,我们一直被利用机器学习 (ML) 的产品所包围。它决定了我们在社交媒体上看到的内容、找到最佳旅行路线的 GPS 系统以及电子商务网站上推荐适合我们偏好的产品的推荐引擎。

然而,我们正在见证计算能力的进步和广泛数据集的可用性推动的飞跃。这些因素使得生成式人工智能(AI 的一个子集,专注于创建新内容和解决方案)以及旨在解释和生成人类语言的大型语言模型 (LLM) 取得了突破。我们与技术的关系正在经历深刻的转变,揭示了曾经超出我们想象的新可能性。

事实上,在不了解用户需求、明确定义问题以及评估人工智能的适当应用的情况下仓促采用人工智能驱动的解决方案往往会导致令人失望的结果。在某些情况下,特别是当在医疗保健等敏感领域使用人工智能解决方案时没有足够的保障措施时,后果可能是完全危险的,对用户隐私、安全和福祉构成风险。

作为用户体验专业人士,解决这些主题是我们职责的一部分,我坚信用户研究从未如此重要。

01. 人工智能集成水平

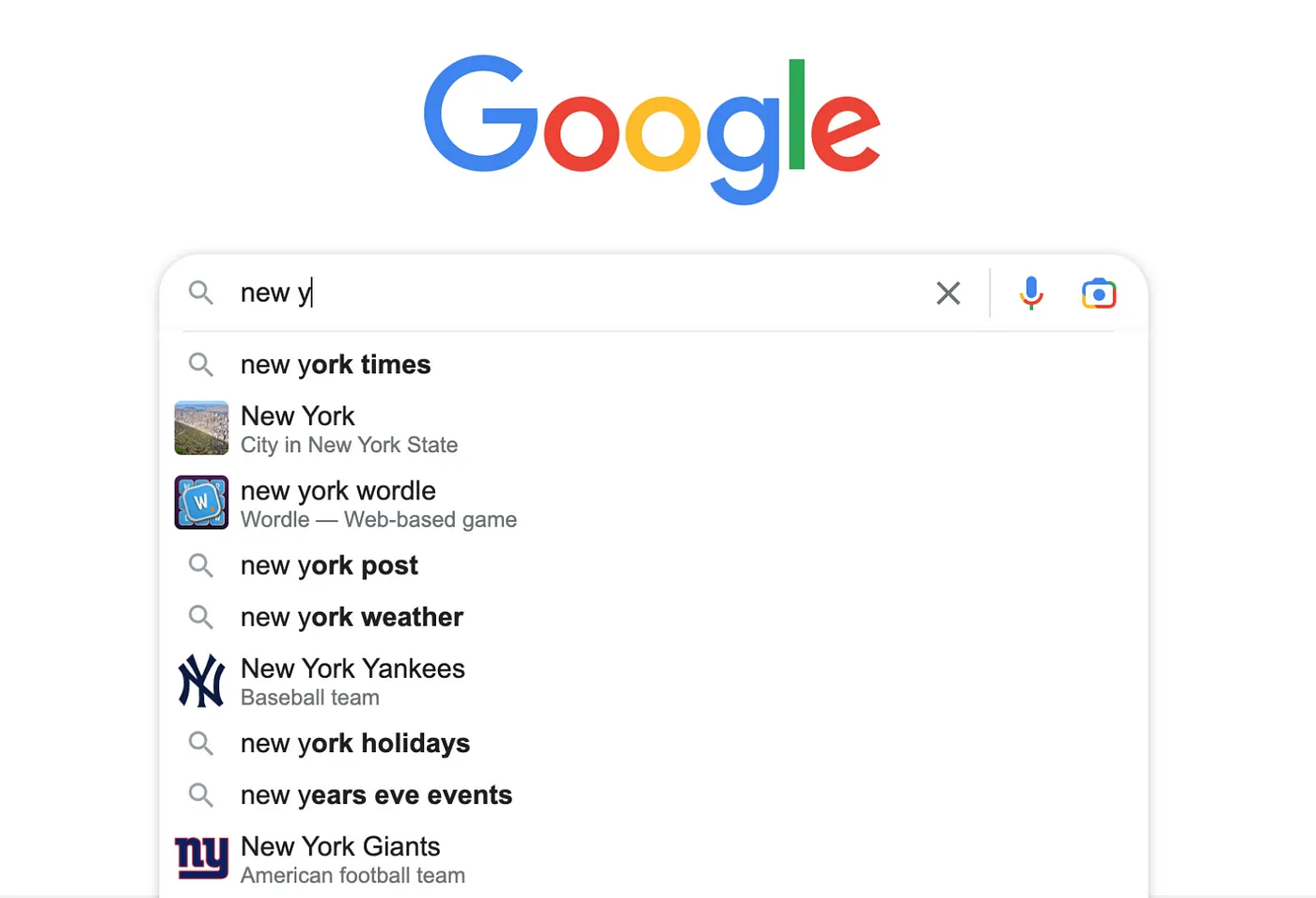

从用户体验的角度来看,最常见的是,人工智能增强了传统软件的功能,例如自动完成或预测分析。例如,谷歌的自动完成功能可以通过最少的用户输入智能地预测搜索查询,从而提供更高效和定制的搜索体验。

在这些情况下,用户研究人员和用户经常发现自己处于熟悉的领域。有时,人工智能的存在是如此微妙,以至于用户甚至可能没有意识到它的存在。这里用户研究的重点是了解这些人工智能增强功能如何影响用户交互和对产品价值的感知。

那么,人工智能就可以成为用户交互的驱动力。例如,考虑聊天机器人或语音识别系统。一个熟悉的例子是我们手机中的语音助手,例如 iPhone 上的 Apple Siri,它可以执行诸如根据我们的语音命令发送消息等任务。

在这里,用户研究的重点是用户如何适应这些新的交互形式,评估他们的直观性、效率、采用率和总体满意度。

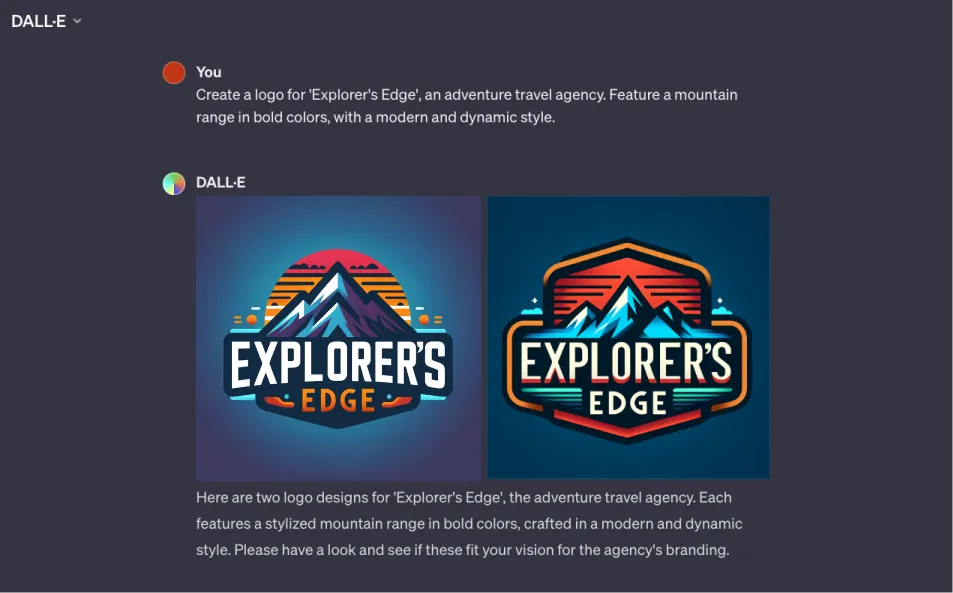

该界面还可以集成人工智能来自动化或完全重新定义工作流程,标志着人机关系的重大飞跃。标志设计中的生成式人工智能是一个简单的例子:它自动执行传统上由人类主导的步骤,例如草绘初步想法、尝试形状、颜色、排版等。这是我使用 DALL·E 为“Explorer’s Edge”创建的标志”,一家虚构的冒险旅行社。

Jakob Nielsen 在他的文章《AI:60 年来首个新 UI 范式》中强调了生成式 AI 转型:

“有了新的人工智能系统,用户不再告诉计算机该做什么。相反,用户告诉计算机他们想要什么结果。”

这一阶段的用户研究探索新的问题,包括对人工智能决策能力的信任、定义自动化的范围以及确保机器操作和用户控制之间的平衡。它还探索了用户与人工智能系统形成的情感联系。

这种范式转变要求用户体验团队和用户研究人员不断调整和发展他们的方法来应对新的挑战,我们将在本文中探讨其中的一些挑战。

02. 拥抱看不见的事物:“绿野仙踪”方法

人工智能使用的持续转变正在引导我们从静态界面转向主动的个性化助手,根据个人偏好、环境和习惯进行微调,并实现端到端体验。这些新概念需要进行测试,特别是因为开发成本高昂,而且原型制作(尤其是生成式人工智能)提出了重大挑战。

这正是“绿野仙踪”方法发挥作用的地方。在这种用户研究方法中,用户与一个虚假的自动化界面进行交互,该界面实际上是由幕后的人控制的。它从封闭场景(具有适合结构化探索的预定义响应)转变为开放场景(实时定义响应以更深入地了解用户期望)。

当我们无法轻松访问 GPT 等模型时,我就开始使用“绿野仙踪”。这项技术使我们能够在网站上模拟实时聊天机器人和用于基于电话的客户支持的语音助手。

.webp)

我们获得了重要的见解,例如确定与不同受众产生共鸣的特定交互模式、用户寻求人性化接触的精确时刻以及引起共鸣的语气。

事实证明,这种方法在我们与工程师的合作中非常有价值。它使我们能够以只有第一手用户见解才能提供的精确度来引导机器学习模型的开发。真正的机器学习模型可能需要数月时间且预算严重紧张的迭代在短短几天内就完成了,并且重点关注用户。我们承认,玩巫师是一种愉快的体验!

03. 发现并适应环境和新的心理模式:纵向研究

创新的人工智能功能通常会随着时间的推移而发挥其真正的潜力,远远超出用户发现和交互的初始阶段。考虑一下从第 1 次到第 10 次,甚至第 100 次使用人工智能产品时,用户习惯是如何演变的。这些转变有时可能涉及学习曲线,我们需要研究和预测。他们还可以与产品建立情感联系,例如,通过与提供个性化响应的人工智能助手进行互动。

随着人工智能产品引入新的心理模型,理解和跟踪用户的感知、期望和情感投入的变化变得不可或缺。纵向研究提供了一种强大的方法来跟踪这些随时间的变化。

纵向用户测试是一种实用的选择,并且相对容易实施。此方法涉及在产品生命周期的各个阶段对同一组用户进行用户测试。强烈建议提前收集用户数据,以创建尽可能个性化且与上下文相关的场景。这种方法可以观察用户体验随着产品变化以及用户变得更加习惯而发生的演变。

日记研究对于人工智能产品也非常有效。在这种方法中,参与者维护日记(通常是数字日记),记录他们在一段时间内与产品或服务的交互。这种方法产生了关于不断发展的用户体验的丰富的定性数据,其特点是挑战、挫折和愉快的时刻。这些见解为用户的现实世界环境提供了重要的清晰度。

例如,在我开发配备语音识别功能的智能家庭助理的项目中,一项基本功能是为房间中的家庭成员选择播放列表。日记研究揭示了不可预见的情况,例如当多个具有不同偏好的家庭成员在场或当用户有客人来访时。他们还强调了一天中的时间和用户的情绪对其与产品交互的影响,强调人工智能系统需要适应这些动态的人为因素。这些见解有助于使产品适应现实生活中的复杂情况。

对于那些有兴趣进一步探索人工智能日记研究的人,我推荐Nielsen Norman Group 关于使用 ChatGPT、Bard 和 Bing Chat 进行信息搜寻的文章。

04. 不断增强人工智能模型:用户反馈循环

就像任何产品一样,通过各种方法(例如分析、A/B 测试、应用内调查和会话重播)持续收集用户交互的反馈至关重要。

随着模型的不断发展,人工智能产品从开发周期的一开始就尤其如此。尽早启动试点测试至关重要。它可以从 alpha 测试开始,内部团队严格检查人工智能模型。由不同组织的专业知识进行的这种深入审查可以识别并纠正关键功能和准确性问题。在 alpha 测试之后,beta 测试允许将人工智能产品介绍给选定的一组真实用户,从而扩大反馈范围。此阶段的重点是了解产品在日常使用的复杂性中的表现,获得以用户为中心的第一手见解。

人工智能产品的特点之一是其即时调整的能力。嵌入产品中的用户反馈可以直接训练和完善机器学习算法,每次交互都充当新的数据点,增强人工智能对用户偏好的准确性和响应能力。在实施这些反馈机制时,必须保持平衡以防止用户不知所措。

让我们来看看现有反馈机制的一些实际应用。它们通常包括赞成/反对评级、有关结果的相关性或有用性的查询以及用户排除或报告内容的选项。

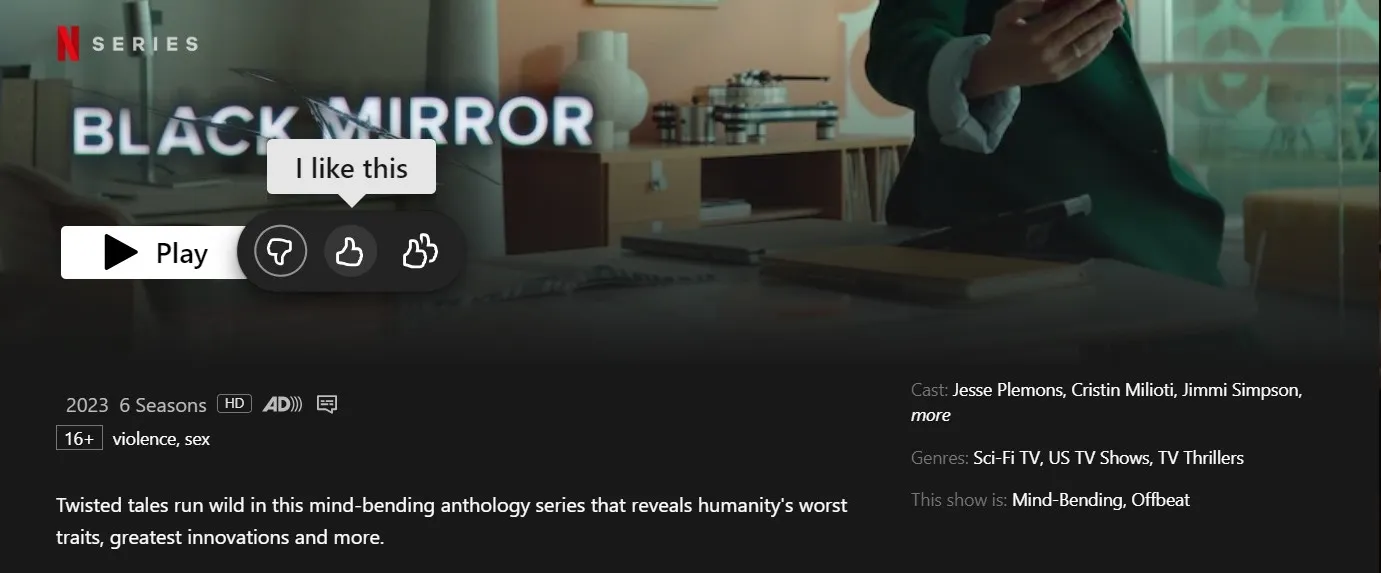

Netflix 有一个“评分”功能,用户可以通过选择“不适合我”、“我喜欢这个”或“喜欢这个”等选项来影响推荐。

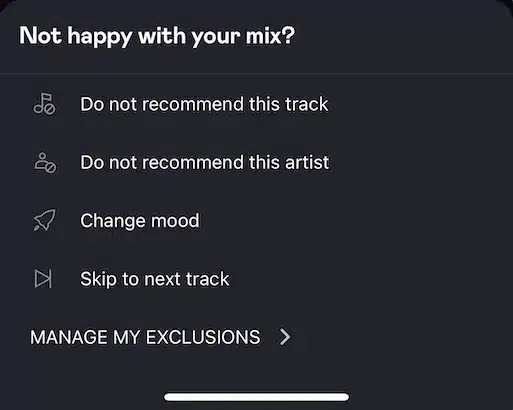

在 Deezer 音乐流媒体应用程序中,用户可以表达对曲目或艺术家的不喜欢,要求系统将来不要推荐类似的选项。

在 ChatGPT 这样的人工智能聊天机器人中,用户可以提供对生成内容的反馈、比较不同的响应或选择最佳的响应。

这些反馈结果可以与其他用户研究方法结合起来进行分析,例如检查用户日志或进行后续访谈,以获得更深入的见解和更全面的背景。

人工智能模型的快速进步为用户研究带来了新的机会,这表明需要创新的实时反馈循环格式。

05. 探索道德领域:用户研究在人工智能信任和责任中的作用

随着人工智能变得越来越普遍,快速集成和采用与道德挑战之间的紧张关系随之出现。各种组织和公司正在制定人工智能原则来指导负责任的发展,例如联合国教科文组织和人工智能联盟,它们通过开放创新促进安全和负责任的人工智能。从人工智能产品开发之初就解决偏见、透明度、安全、道德问题和用户控制等问题是关键。用户研究可以帮助团队应对这些挑战并减轻道德债务和负面社会后果。

必须特别关注训练数据集中的偏差。这种偏见有可能显着影响人工智能性能和用户体验,往往会延续甚至放大现有的不平等现象。例如,谷歌和霍华德大学之间的一项研究合作项目“Elevate Black Voices”展示了如何整合更广泛的声音和观点来显着增强所有用户的语音识别技术。同样,在人工智能越来越多地使用的招聘实践中,仔细检查偏见对于防止歧视至关重要。用户研究人员带来了确保数据代表性和道德完整性的重要技能,适应既定框架并采用同意书和数据管理政策等基本工具来进行负责任的数据收集。

用户测试、访谈、焦点小组和调查等用户研究方法有助于确保产品开发过程中持续进行道德评估。也可以使用专门的研究实验。例如,道德机器实验专注于自动驾驶汽车的道德决策,旨在收集人类对这些困境的看法。这项实验揭示了一种全球趋势,即优先拯救人类而不是宠物,优先保护更大的群体而不是个人,以及保护儿童和孕妇。该实验还揭示了特定的文化差异。例如,与日本、印度尼西亚、巴基斯坦和沙特阿拉伯等国家相比,拉丁美洲和法国更倾向于保留年轻角色而不是年长角色。这些都是需要讨论的考虑因素。

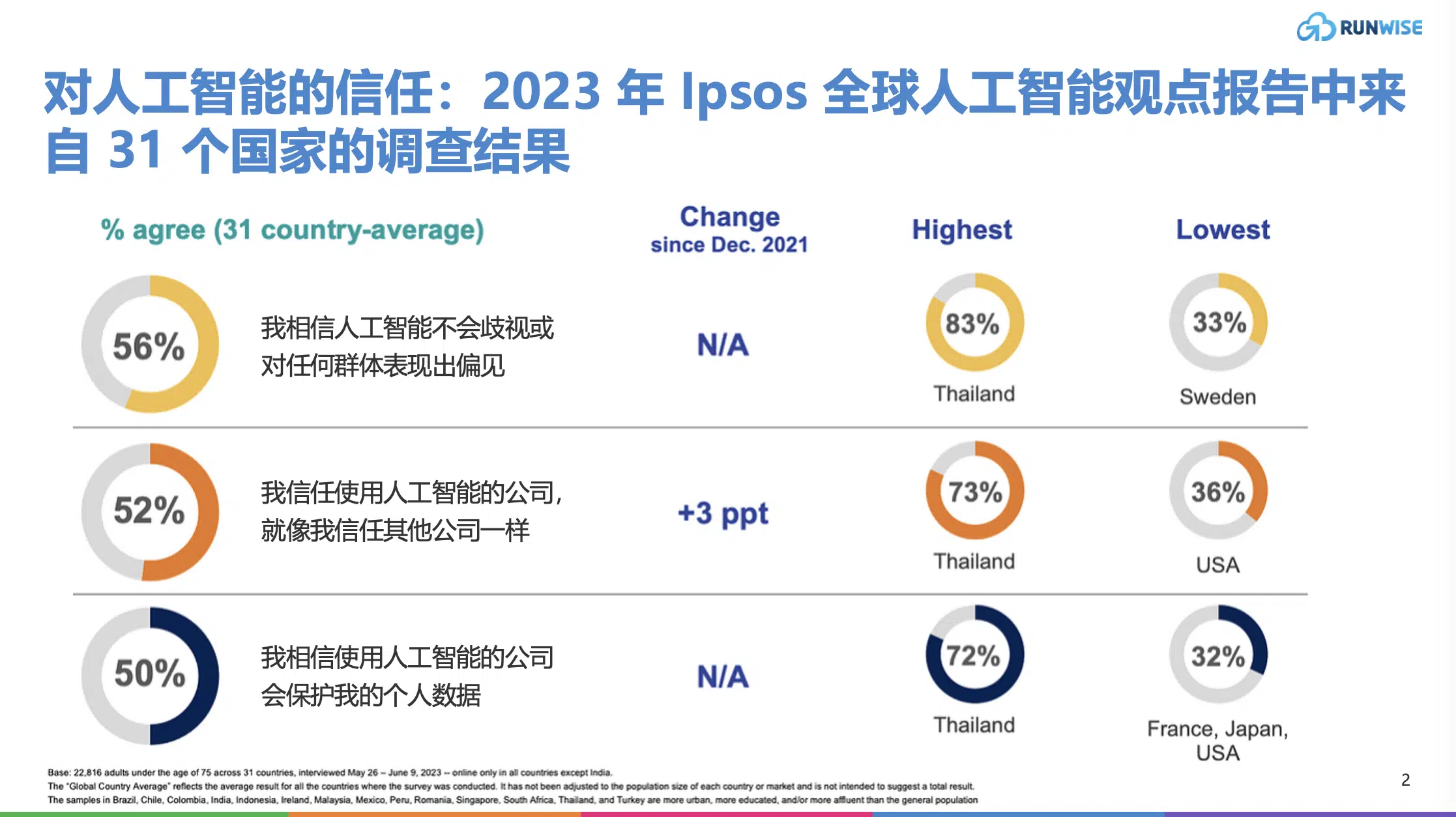

随着产品服务于全球市场,保持广阔的视野变得越来越重要。网上的大量研究可以揭示社会对人工智能的态度。下图取自益普索《2023 年人工智能全球观点》报告,展示了人们对人工智能信任的显着差异,强调了可能影响用户接受度的文化差异。该研究显示出显着的差异,新兴市场和 40 岁以下的个人表现出明显更高的信任水平。这可以为用户研究策略提供信息和完善,确保产品在不同的文化背景下具有相关性。

用户研究还有助于了解人工智能决策的影响,例如不准确的后果。预测和监控人工智能系统的潜在错误、黑暗模式和负面影响可以做出明智的设计选择。就我而言,不同项目的风险差异很大。在电子商务中,不一致的推荐可能只会让客户感到轻微的烦恼或无关紧要。然而,在能源等关键领域,管理网络参数的预测模型的不准确可能会带来重大的安全隐患。全面的用户研究有助于降低风险并建立护栏。尤其是人种学研究,可以深入了解人工智能如何在复杂的现实场景中使用,从而更全面地理解用户交互。例如,通过在能源领域进行研究,我们发现即使是看起来很容易实现自动化的流程,实际上也依赖于未连接的系统并需要手动输入。这强调了需要允许手动调整人工智能模型的参数以实现准确对齐。

用户研究仍然是创造技术先进且以人为本的人工智能产品的核心。通过采用“绿野仙踪”、纵向研究等方法,并结合用户反馈循环,我们确保人工智能模型始终关注用户需求。用户体验团队、产品专家、技术专家和其他利益相关者之间的合作是关键。在整个产品开发周期中的这种努力可以更有效地整合用户需求,并鼓励必要的(有时是具有挑战性的)道德讨论。研究人员不仅可以帮助探索人工智能在产品中的影响,还可以更广泛地探索用户环境中的影响。

展望未来,人工智能系统将日益成为用户研究的一部分。他们正在改变我们使用的方法和工具,特别是在数据分析和行为预测方面。这种演变释放了新的可能性,以我们意想不到的方式简化流程并理解用户交互。然而,至关重要的是,我们要记住,没有什么可以取代人类的洞察力。毕竟,人工智能是由人类设计、为人类服务的。

- 如何通过用户研究打造更好的人工智能产品

- AI:60 年来第一个新的 UI 范式,作者:Jakob Nielsen,2023

- 使用生成式 AI 进行信息搜寻:对 3 个聊天机器人的研究,作者:Raluca Budiu、Feifei Liu、Emma Cionca 和 Amy Zhang,2023 年

- 《道德机器实验》作者:Edmond Awad、Sohan Dsouza、Richard Kim、Jonathan Schulz、Joseph Henrich、Azim Shariff、Jean-François Bonnefon、Iyad Rahwan。自然,2018

- “我不认为这些设备具有很强的文化敏感性。” — 自动语音识别错误对非裔美国人的影响,作者:Zion Mengesha、Courtney Heldreth、Michal Lahav、Juliana Sublewski、Elyse Tuennerman。2021 年人工智能前沿

- 人工智能招聘实践中的道德和歧视 作者:Zhisheng Chen。自然,2023

人工智能会产生社会影响,但谁为此付出代价?科技公司的“道德债务”问题作者:Casey Fiesler,2023 年

- 医学领域的人工智能革命,作者:Alvin Powell,2020

- 数据说明了美国人对人工智能的看法,皮尤研究中心,2023 年

![社交平台如何破局冷启动?拆解 Tinder 撬动 7.5 亿月活的增长与变现飞轮 [附信息图解]](https://runwise.co/wp-content/uploads/2023/07/Tinder_growth-300x200.png.webp)

![生成式AI商业化7步路线图:[附2026全景图] CDO如何从0构建“AI就绪”的数据架构?](https://runwise.co/wp-content/uploads/2023/11/Fueling-generative-AI-300x157.png.webp)